Günstigste KI-Beschleuniger für lokale KI & LLM-Modelle: Leistungsvergleich mit Gemma4 und LLAMA3

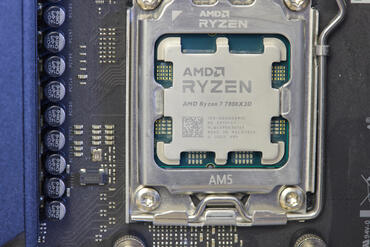

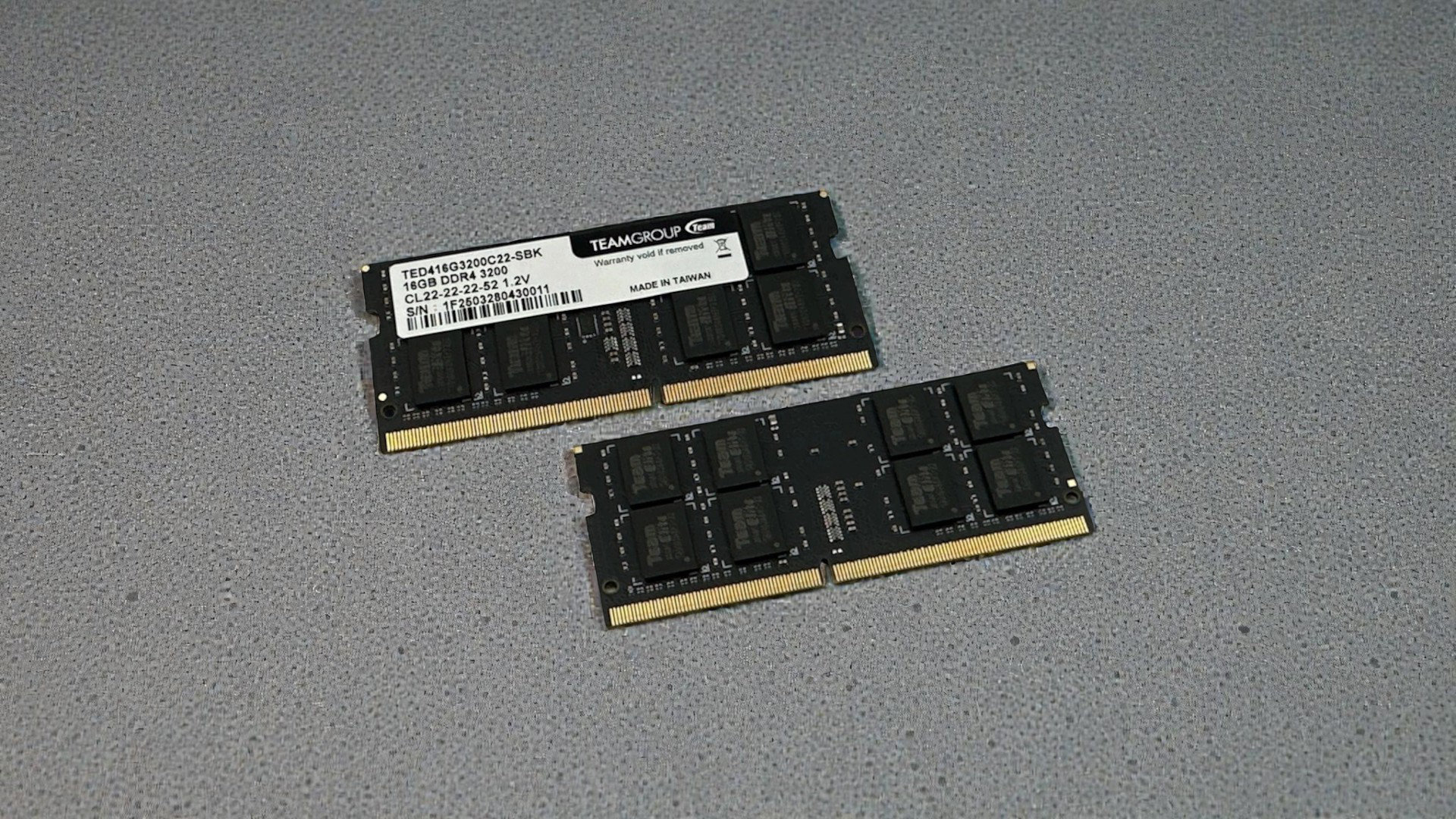

Durch die immer größer werdende Vielfalt an offenen KI-Modellen wächst auch das Interesse am lokalen Deployment. Das Fieber hat auch uns erwischt und wir haben über das letzte Jahr verteilt viel experimentiert und einige günstige Grafikkarten und Beschleuniger dafür ausprobiert. In diesem Artikel teilen wir die Erfahrungen mit 16- und 32-GB-VRAM-GPUs und dem Deployment.