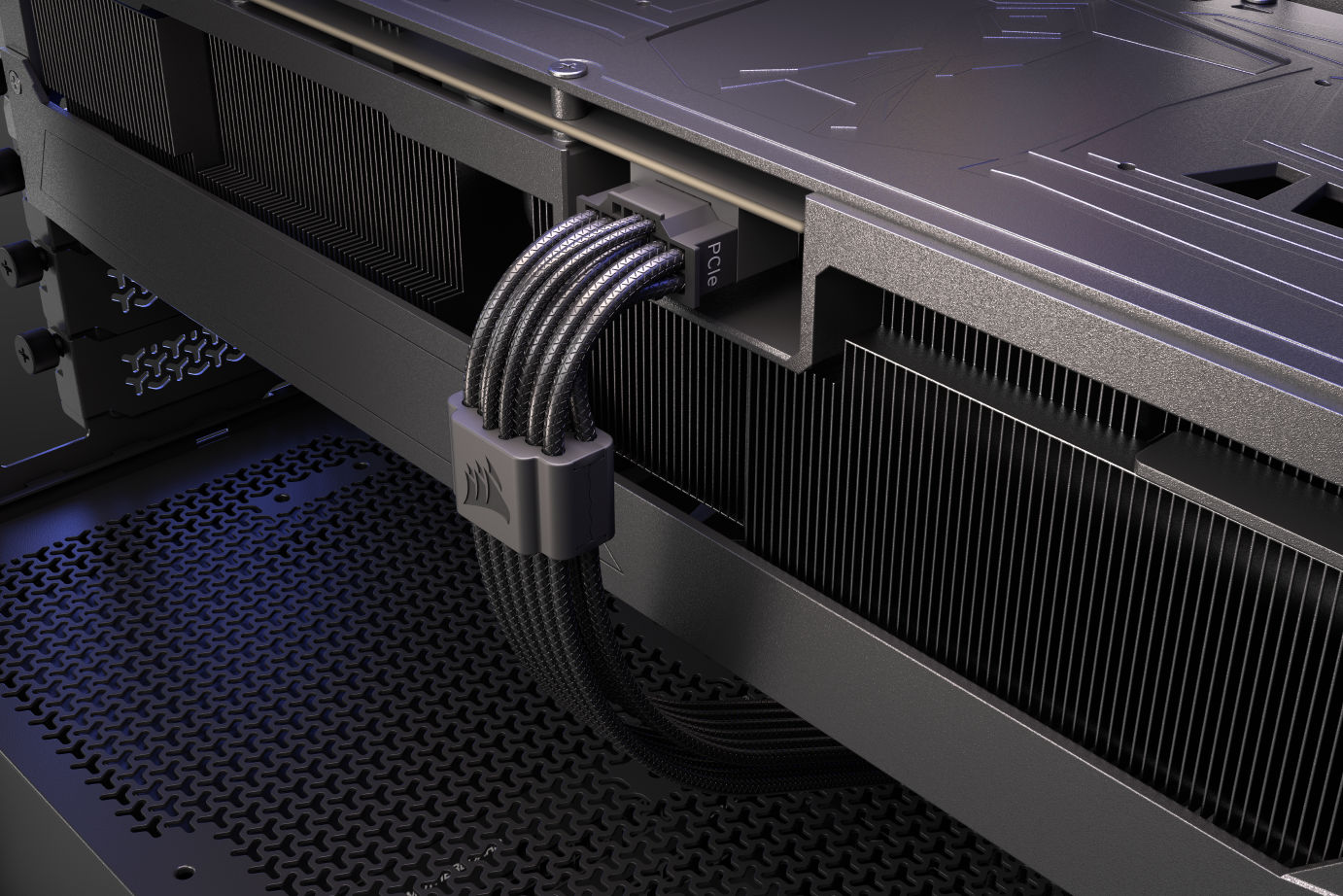

Corsair ThermalProtect 12V-2x6-GPU-Stromkabel mit integrierter Temperaturüberwachung erhältlich

Corsair hat ebenfalls ein spezielles ThermalProtect 12V-2x6-Grafikkartenstromkabel vorgestellt, das durch die Echtzeitüberwachung der Kabeltemperaturen das Risiko von Schäden an Grafikkarten der GeForce RTX 50-Serie verhindern soll. Das Kabel wurde entwickelt, um eine Sicherheitsstufe auf Hardwareebene für Hochleistungsgrafikkarten zu bieten.