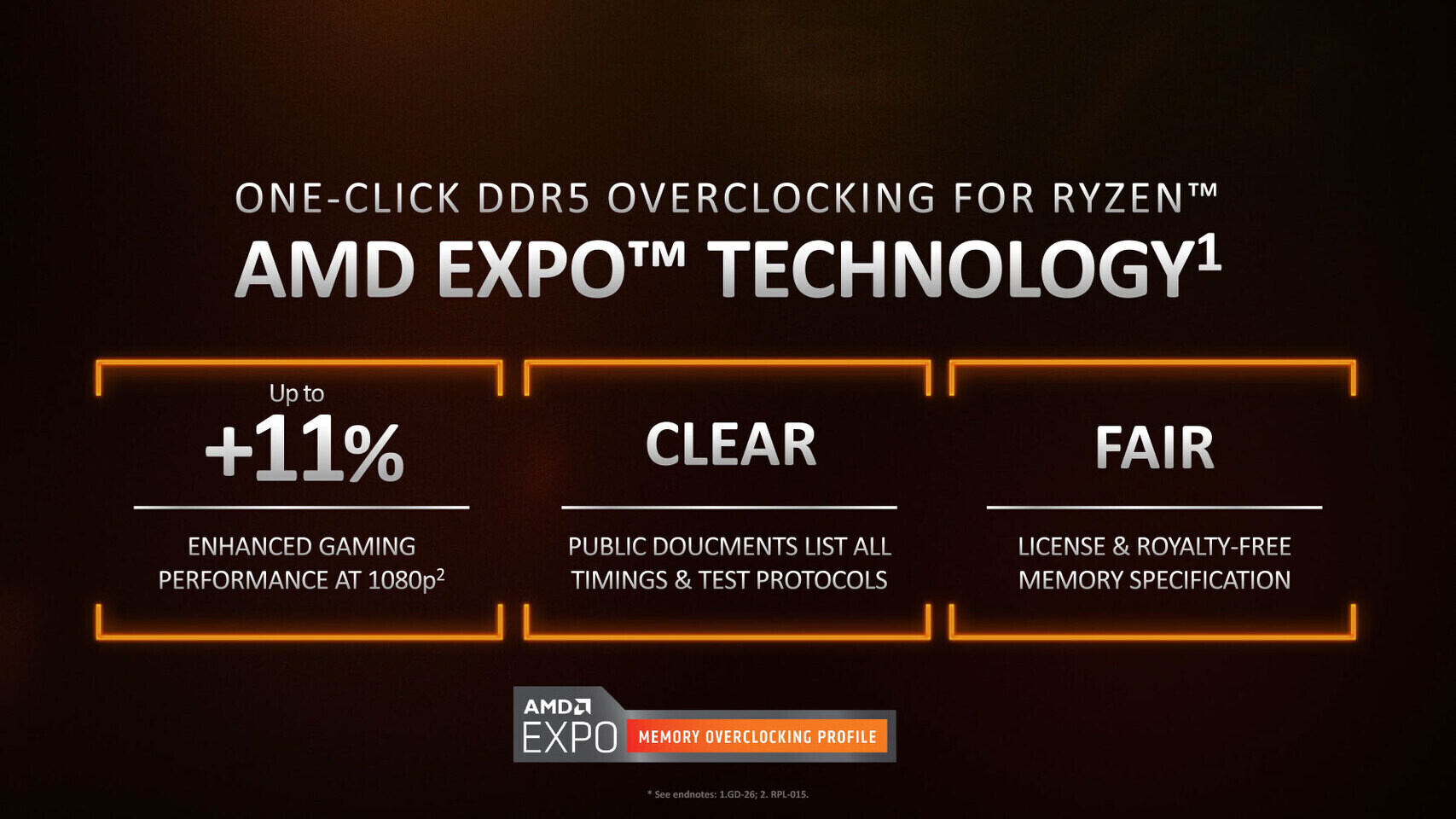

Was bringt AMD EXPO 1.2? Die neue Erweiterung der DDR5-Speicheroptimierung und Hardwareunterstützung

AMD hat offiziell die Version 1.2 von „Extended Profiles for Overclocking“ (EXPO) veröffentlicht. Das Spezifikationsupdate zielt daruaf ab, die Bandbreite kompatibler Speicherprofile zu erweitern und präzisere Optimierungsoptionen für DDR5-Speicher einzuführen. Wir erklären die Neuerungen des Updates.