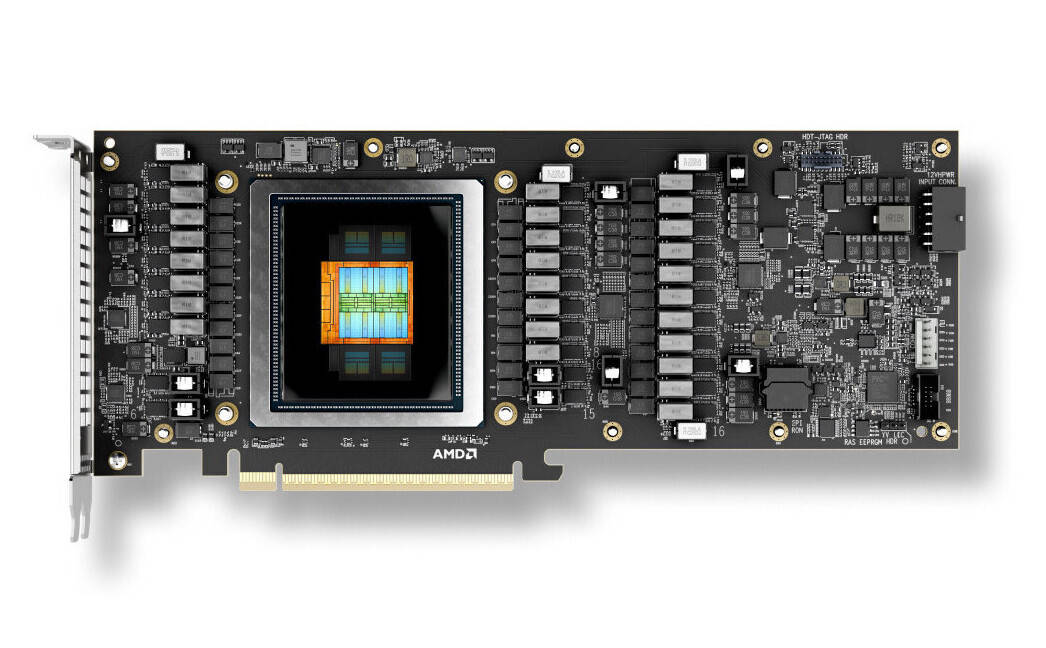

AMD Instinct MI350P GPU (Bild © AMD)

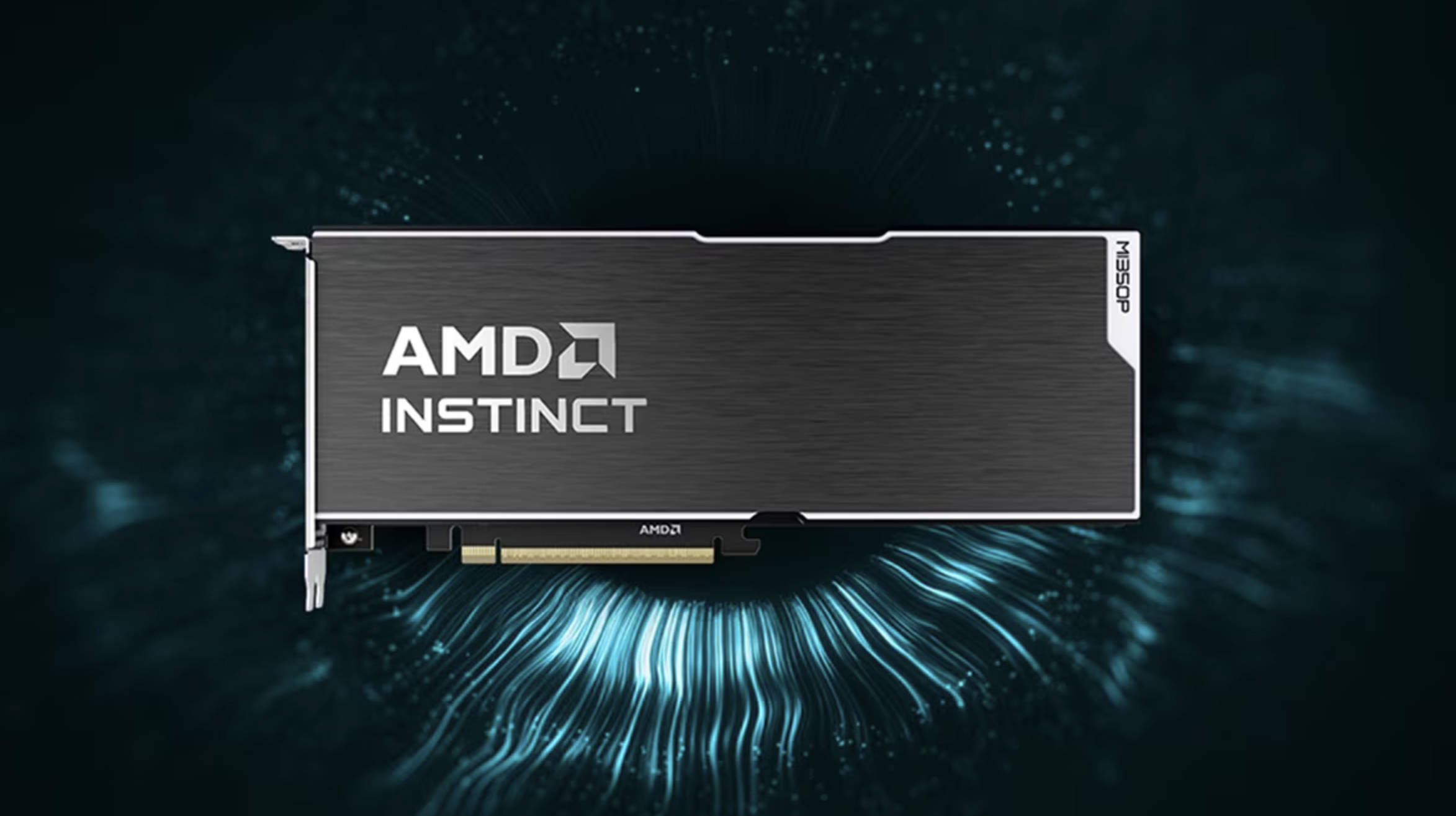

AMD Instinct MI350P GPU (Bild © AMD)

Die Instinct MI350P ist als Dual-Slot-Drop-in-Karte konzipiert, sodass Unternehmen ihre aktuellen Server aufrüsten können, ohne die Stromversorgung oder Kühlsysteme im Rack ändern zu müssen. Dieser Formfaktor richtet sich speziell an Unternehmen, die mehr Rechenleistung benötigen, als Standard-CPUs bieten, aber eine vollständige Umstellung auf dedizierte GPU-Beschleunigerplattformen nicht rechtfertigen können. Diese Karten können in luftgekühlten Systemen mit Konfigurationen von bis zu acht Beschleunigern eingesetzt werden, wodurch sie für verschiedene KI-Modellgrößen und RAG-Pipelines geeignet sind.

Technische Spezifikationen und Leistung

Um den Anforderungen der agentischen KI gerecht zu werden, konzentriert sich die MI350P auf hohen Durchsatz und Speichereffizienz. Die Hardware liefert geschätzte 2.299 TFLOPS und erreicht bei Verwendung der MXFP4-Präzision bis zu 4.600 TFLOPS Spitzenleistung. Dies entspricht einer der höchsten Leistungen, die derzeit bei einer PCIe-Karte für Unternehmen verfügbar sind. Speicherengpässe werden durch 144 GB HBM3E-Speicher mit Geschwindigkeiten von bis zu 4 TB/s behoben.

Die Leistung wird durch Sparsity-Unterstützung für gängige 8- und 16-Bit-Präzisionen weiter optimiert. Durch die Unterstützung eines breiten Spektrums an Präzisionsstufen – darunter FP8, MXFP8 und MXFP4 – maximieren die Karten den GPU-Durchsatz und reduzieren den Speicherverbrauch, was wiederum den Strom- und Kühlungsbedarf innerhalb der Grenzen von Standard-Rechenzentren hält.

Offener Software-Stack und Interoperabilität

Die Hardware wird von einem offenen KI-Ökosystem unterstützt, das Herstellerabhängigkeit verhindern und die Migration von Inferenz-Workloads vereinfachen soll. Der AMD Enterprise-KI-Stack lässt sich in branchenübliche Tools integrieren, darunter den Kubernetes GPU Operator für das Lebenszyklusmanagement und native Unterstützung für das PyTorch-Framework.

Um die Betriebskosten zu senken, wird der Enterprise-KI-Referenzstack den Partnern als Open-Source-Angebot zur Verfügung gestellt. Dieser Ansatz macht Lizenzgebühren überflüssig und eliminiert die bei cloudbasierten KI-Bereitstellungen üblichen Gebühren pro Token. Da das System auf offenen Standards basiert, können Unternehmen bestehende KI-Pipelines mit minimalen Änderungen am Code migrieren.

Bereitstellungsstrategie

Durch die Nutzung des PCIe-Formfaktors ermöglicht der MI350P Unternehmen den Umstieg von Bare-Metal-Infrastrukturen auf produktionsreife KI-Systeme. Die Möglichkeit, mehr Modelle auszuführen und eine größere Anzahl von Nutzern innerhalb der vorhandenen Infrastruktur zu bedienen, ermöglicht die Skalierung von KI-Fähigkeiten, ohne das physische Rechenzentrum komplett umbauen zu müssen.