Google TurboQuant Was ist TurboQuant (Bild © Google)

Google TurboQuant Was ist TurboQuant (Bild © Google)

VRAM-Beschränkung bei der LLM-Inferenz lösen

In Transformer-basierten Architekturen speichert der KV-Cache Schlüssel- und Wertvektoren für jedes Token in einer Sequenz, um redundante Berechnungen zu vermeiden. Da dieser Cache linear mit der Kontextlänge wächst und in der Regel volle Genauigkeit (FP16) nutzt, beansprucht er oft den Großteil des verfügbaren GPU-VRAM. So kann beispielsweise ein Modell mit 8 Milliarden Parametern und einem Kontextfenster von 32 KB allein für den Cache etwa 4,6 GB VRAM benötigen.

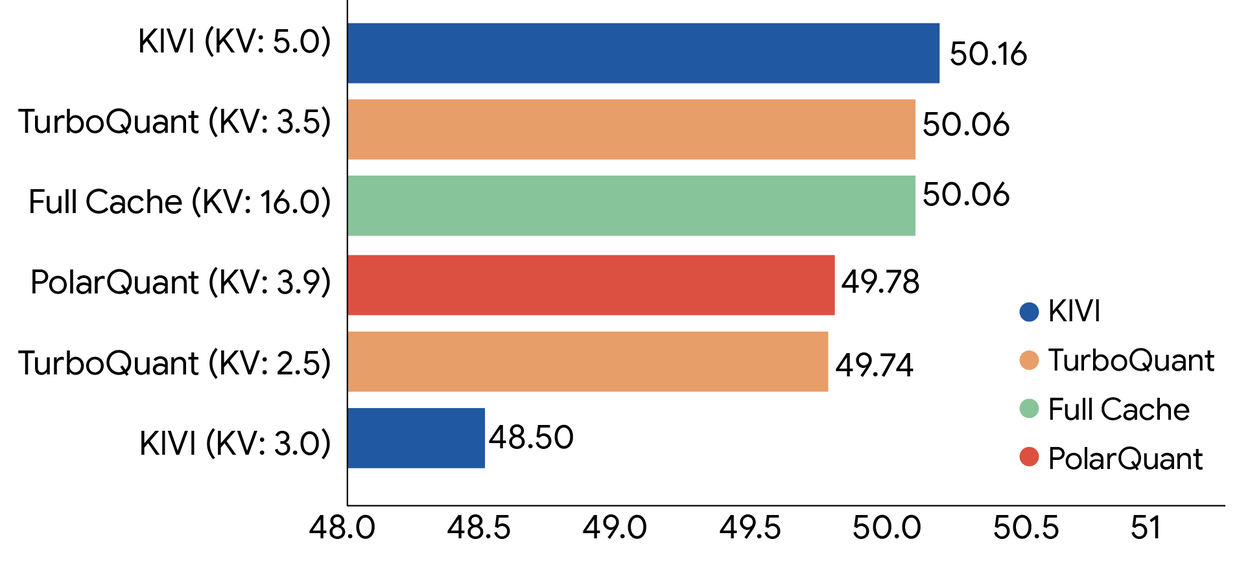

Bisher boten bestehende Quantisierungsmethoden entweder eine unzureichende Komprimierung oder führten zu unvorhersehbaren Qualitätseinbußen. TurboQuant löst dieses Problem durch einen trainingsfreien, modellunabhängigen Ansatz, der über verschiedene Transformer-Architekturen hinweg funktioniert, ohne dass Kalibrierungsdatensätze erforderlich sind.

Zweistufige Komprimierungsprozess

TurboQuant arbeitet mit einer speziellen zweistufigen Pipeline, um Verzerrungen zu minimieren:

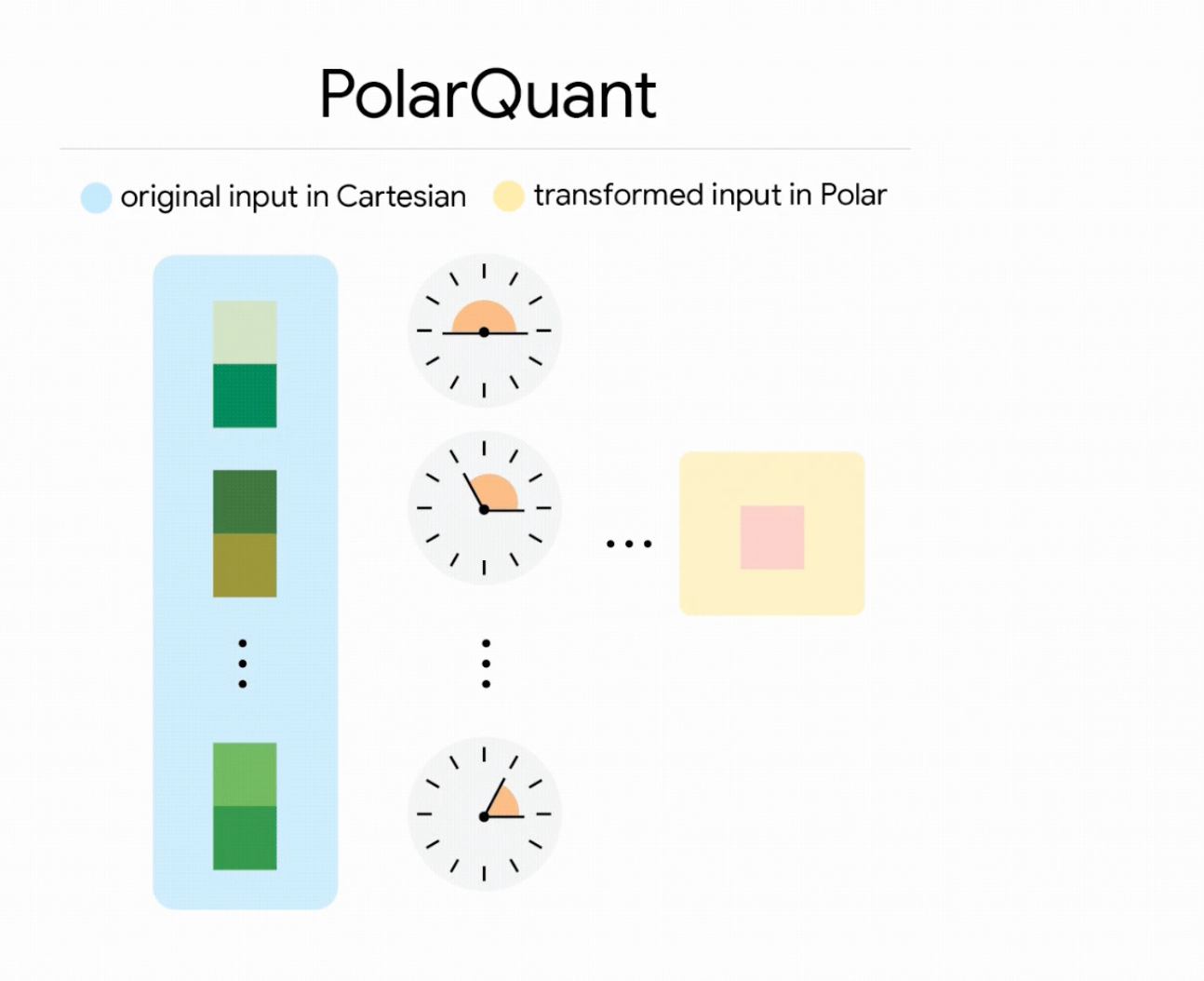

Zunächst wendet PolarQuant eine zufällige orthogonale Drehung auf jeden KV-Vektor an. Dieser Prozess verteilt die Energie des Vektors gleichmäßig, sodass das System einen mathematisch optimalen Satz von Quantisierungsbins verwenden kann, der über den Lloyd-Max-Algorithmus abgeleitet wird. Durch die Umwandlung der Koordinaten in Polarkoordinaten macht der Algorithmus kostspielige Normalisierungskonstanten pro Block überflüssig.

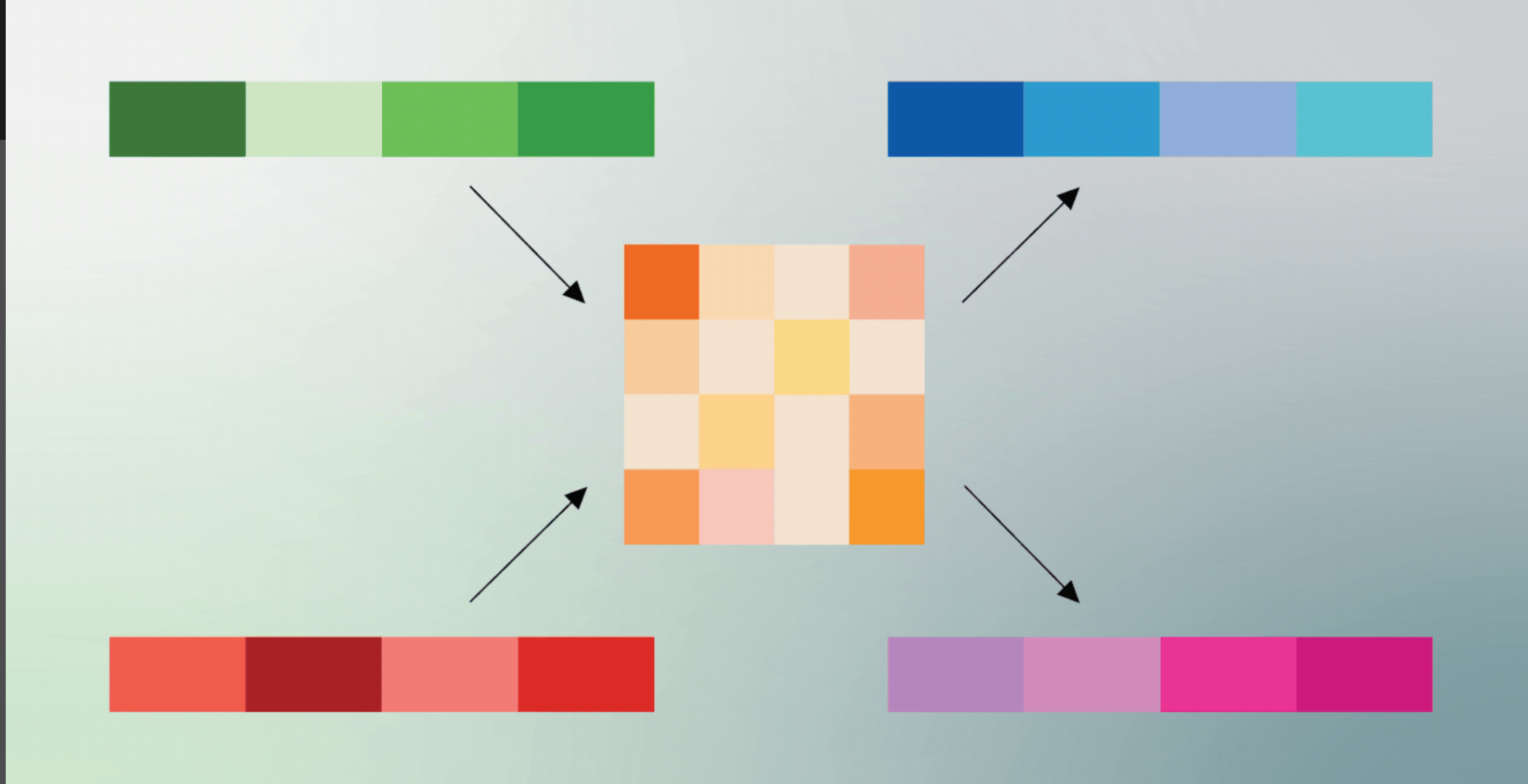

Zweitens behandelt die QJL-Residualkorrektur die verbleibenden Quantisierungsfehler. Sie projiziert diese Fehler über eine zufällige Gauß-Matrix unter Verwendung der Johnson-Lindenstrauss-Transformation und speichert dabei nur das Vorzeichenbit. Dieser Ein-Bit-Overhead wirkt als Bias-Korrektur und stellt sicher, dass die Attention-Scores mathematisch unverzerrt bleiben.

Auswirkungen auf die Bereitstellung und die Hardware-Auslastung

Für Entwickler und Ingenieure besteht der Hauptvorteil von TurboQuant in der Möglichkeit, längere Kontextfenster auf bestehender Hardware auszuführen. Durch die deutliche Senkung der Speichergrenze verhindert es Out-of-Memory-Fehler auf GPUs mit begrenztem VRAM.

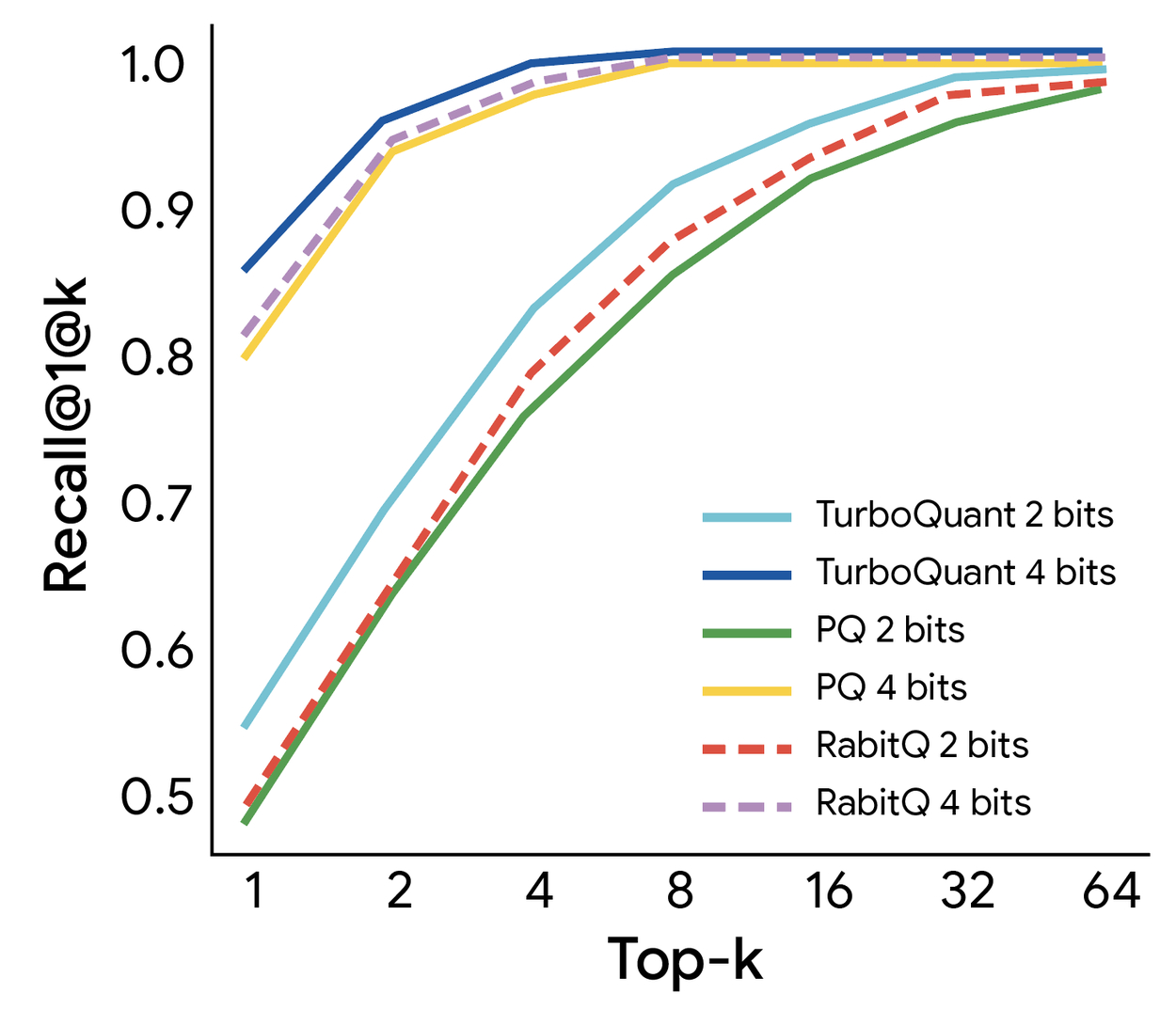

Darüber hinaus verbessert der Algorithmus die Inferenzgeschwindigkeit unter hoher Speicherbelastung. Wenn ein Standard-FP16-Cache eine GPU zwingt, auf den System-Swap-Speicher zurückzugreifen, bricht der Durchsatz in der Regel ein. Community-Benchmarks zeigen, dass TurboQuant einen zwei- bis dreimal höheren Token-Durchsatz aufrechterhält, indem sichergestellt wird, dass der komprimierte Cache im Hochgeschwindigkeits-GPU-Speicher verbleibt. Über LLMs hinaus ist der Algorithmus auch auf hochdimensionale Einbettungsindizes bei der Vektorsuche und der Nearest-Neighbor-Abfrage anwendbar.

TurboQuant Integration

TurboQuant ist derzeit über ein von der Community entwickeltes Python-Paket turboquant verfügbar, das als Ersatz für den HuggingFace-KV-Cache dient. Diese Implementierung umfasst einen OpenAI-kompatiblen Inferenzserver für eine optimierte Bereitstellung.

Lokale LLM-Nutzer können über llama.cpp-Community-Forks wie turboquant_plus, das Metal-GPU-Kernel für Apple Silicon enthält, auf die Technologie zugreifen. Es gibt zudem laufende Bemühungen, TurboQuant nativ in das vLLM-Projekt zu integrieren, während die offizielle Implementierung durch Google für das zweite Quartal 2026 erwartet wird.

Technische Überlegungen und Einschränkungen

Die praktische Anwendung von TurboQuant zeigt spezifische Leistungsgrenzen auf. Die 4-Bit-Konfiguration gilt als optimaler Kompromiss, da die Qualität bei Modellen mit 3 Milliarden Parametern oder mehr nahezu identisch mit FP16 bleibt. Modelle mit weniger als 3 Milliarden Parametern zeigen jedoch eine höhere Empfindlichkeit gegenüber Quantisierungsrauschen, insbesondere bei 3-Bit-Stufen, was zu sich wiederholenden oder beeinträchtigten Ausgaben führen kann.

Daten deuten zudem darauf hin, dass die Wertquantisierung kritischer ist als die Schlüsselquantisierung, die Reduzierung von Werten auf 2 Bit verschlechtert die Kosinusähnlichkeit erheblich, während 4-Bit-Werte eine hohe Genauigkeit beibehalten. Schließlich ist der Algorithmus am vorteilhaftesten für Langform-Inhalte. Bei Texten mit weniger als 1.000 Token kann der Aufwand für Rotation und Quantisierung die Speichereinsparungen überwiegen. Um Qualitätsverluste zu mindern, verwenden die meisten Implementierungen ein Residualfenster, das die letzten 128–256 Token in voller FP16-Präzision beibehält. Es ist davon auszugehen, dass vor allem die Open-Source-Modelle nun alle die TurboQuant-Technologie implementieren werden und so die Effizienz und Qualität auf lokalen LLMs steigern.